La disponibilidad de agua potable –es decir, agua segura para el consumo humano– es un logro relativamente reciente en la historia. Durante milenios diversas civilizaciones emplearon métodos básicos para mejorar la calidad del agua, como hervirla, exponerla al sol o filtrarla con arena y carbón, e incluso almacenarla en recipientes de cobre para mantenerla más pura. Sin embargo, estos primeros tratamientos buscaban principalmente mejorar las características organolépticas (eliminar turbidez, malos olores o sabores) más que eliminar patógenos invisibles. No fue sino hasta el siglo XIX, con el avance de la ciencia y el entendimiento de las enfermedades infecciosas, que surgió una preocupación explícita por desinfectar el agua para proteger la salud pública. A continuación se exploran el contexto histórico de esta preocupación, los descubrimientos científicos clave que vincularon el agua contaminada con enfermedades, la evolución de las técnicas de desinfección, las fechas y lugares pioneros en potabilización y el papel fundamental de desinfectantes como el cloro y el ozono en los inicios de la potabilización del agua.

Contexto histórico: de la calidad del agua a la protección de la salud

En la Antigüedad y en épocas premodernas, la calidad del agua se asociaba empíricamente con la salud, aunque sin comprender sus causas microbianas. Ya entre los años 4000 y 2000 a.C. existen registros de métodos para mejorar el agua: hervirla, dejarla al sol, filtrarla con carbón vegetal o arena, o almacenarla en vasijas de cobre. Textos antiguos sugerían, por ejemplo, que el agua impura debía hervirse y filtrarse, y era común dejar reposar el agua en recipientes de barro para decantar impurezas. Estas prácticas mejoraban el aspecto y sabor del agua y, en cierta medida, podían reducir enfermedades, aunque se desconocía la existencia de microorganismos. Hasta bien entrado el siglo XIX persistía la creencia en teorías como el miasma –que atribuía las epidemias a “malos aires” o emanaciones insalubres– y se consideraba que las aguas claras eran automáticamente seguras, mientras que las aguas estancadas de pantanos eran insalubres. En otras palabras, antes del auge de la microbiología, la preocupación sanitaria sobre el agua se centraba más en su apariencia y olor que en la eliminación de agentes patógenos invisibles.

Este panorama comenzó a cambiar a mediados del siglo XIX, en el contexto de la Revolución Industrial y el crecimiento urbano. Grandes ciudades europeas sufrían devastadoras epidemias de enfermedades transmitidas por el agua, como el cólera y la fiebre tifoidea. La acumulación de población, la falta de alcantarillado adecuado y la costumbre de verter residuos fecales en fuentes de agua provocaban brotes mortales. Un ejemplo ilustrativo es la situación de Londres en la primera mitad del siglo XIX: las repetidas epidemias de cólera y el infame “Gran Hedor” de 1858 llevaron a exigir mejoras en el saneamiento urbano. Fue en ese contexto cuando surgió la noción moderna de agua potable como aquella que no solo es clara y de buen sabor, sino también salubre en términos microbiológicos. La emergencia sanitaria forzó a las autoridades y científicos a investigar la relación entre agua y enfermedad, sentando las bases de la potabilización del agua como una prioridad de salud pública.

Agua contaminada y enfermedades: descubrimientos científicos clave

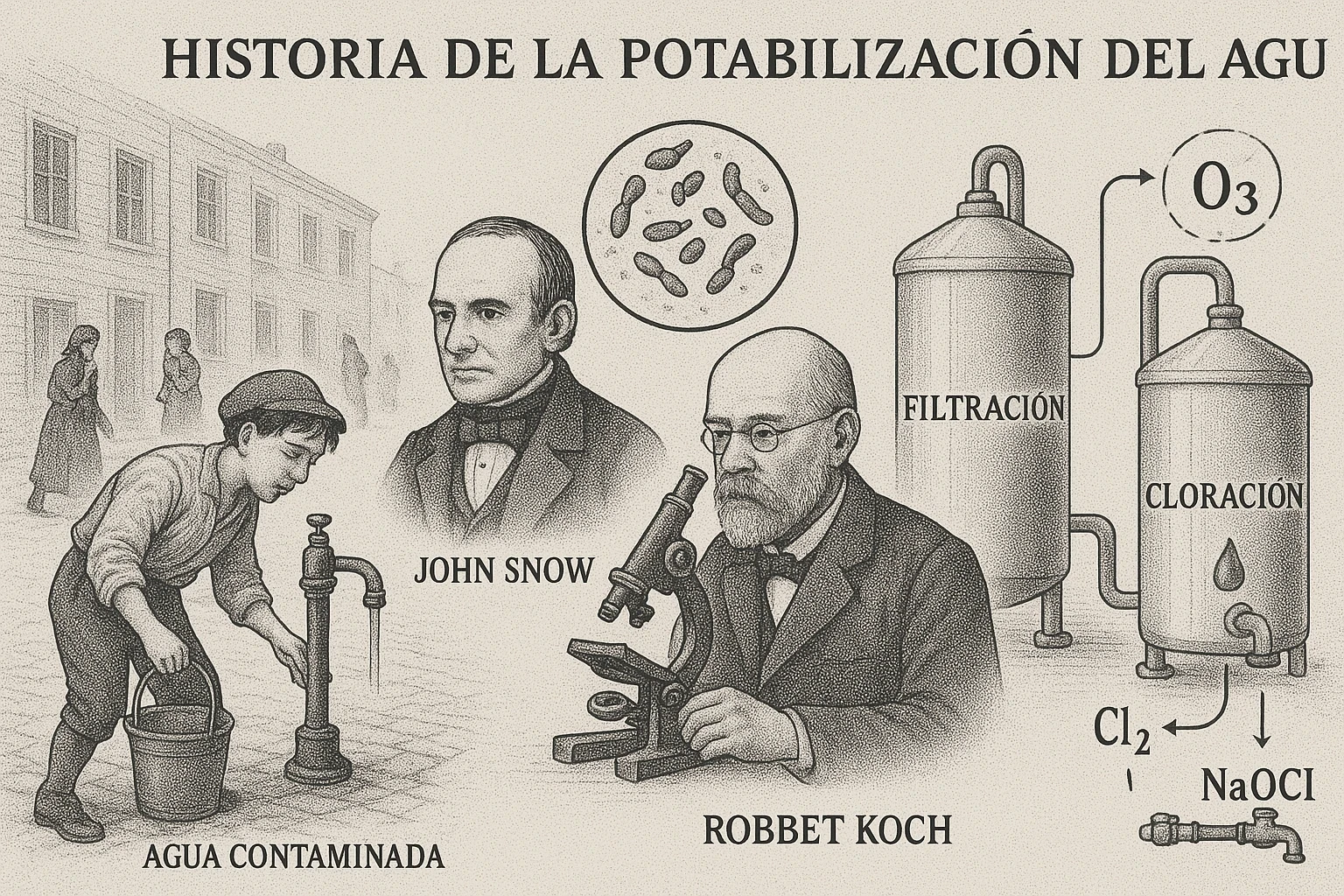

El vínculo entre agua contaminada y enfermedad infecciosa quedó dramáticamente demostrado en el siglo XIX gracias a avances científicos y observaciones epidemiológicas pioneras. Un hito fundamental ocurrió durante la epidemia de cólera de 1854 en Londres. En el barrio del Soho, más de 600 personas murieron en una semana debido al cólera, en un área de apenas unas manzanas. El médico inglés John Snow, considerado precursor de la epidemiología moderna, investigó el patrón de casos y sospechó que la enfermedad se transmitía por el agua de consumo. Contrariando la teoría del miasma dominante, Snow trazó un mapa de los casos de cólera y los concentró alrededor de una bomba pública de agua en Broad Street. Descubrió que dicha bomba suministraba agua de un pozo contaminado por aguas residuales, identificando así al agua contaminada como el vehículo de la infección. Sus hallazgos, publicados en 1855, demostraron de forma concluyente el papel del suministro hídrico en la propagación del cólera. Como medida inmediata, Snow convenció a las autoridades de cerrar la bomba de agua, lo que rápidamente controló el brote. John Snow también fue el primero en utilizar cloro con éxito para desinfectar un suministro de agua durante esta emergencia, vertiendo compuestos clorados en el pozo para intentar purificarlo. Aunque el concepto de germen patógeno aún se estaba desarrollando, el trabajo de Snow marcó un antes y un después: proporcionó evidencia sólida de que el agua podía transmitir enfermedades y que su desinfección podía salvar vidas.

Tras el caso de Londres 1854, la comunidad científica intensificó la investigación sobre microorganismos en el agua. En las décadas siguientes se confirmaría la teoría microbiana de la enfermedad. Destaca el trabajo del alemán Robert Koch, quien en 1883 logró aislar e identificar el bacilo del cólera (Vibrio cholerae), corroborando la causa bacteriana de la enfermedad. Koch también realizó estudios comparativos ilustrativos: por ejemplo, investigó un brote de cólera de 1892 en las ciudades vecinas de Hamburgo y Altona (Alemania), que compartían el río Elba como fuente de agua. Altona filtraba su agua con arena, mientras Hamburgo no; resultó que Altona sufrió una incidencia mucho menor de cólera que Hamburgo, demostrando que la filtración removía al menos parte de las bacterias causantes. Esto reforzó la noción de que intervenciones en el tratamiento del agua (como la filtración, y más tarde la desinfección química) podían prevenir epidemias. Hacia fines del siglo XIX, gracias a científicos como Koch, se aceptó finalmente que microorganismos en el agua causaban enfermedades y, por tanto, que era necesario eliminar dichos gérmenes para hacer el agua segura.

En resumen, los descubrimientos científicos de mediados y finales del siglo XIX –desde la epidemiología de John Snow hasta la bacteriología de Koch y Pasteur– establecieron la conexión clara entre agua contaminada y enfermedades infecciosas. Este conocimiento cambió la perspectiva de las sociedades industrializadas: el suministro público de agua ya no podía evaluarse solo por su claridad o sabor, sino por su inocuidad microbiológica. Nació así la verdadera preocupación por desinfectar el agua potable para proteger la salud pública, impulsando el desarrollo de nuevos métodos de potabilización.

Evolución de las técnicas de desinfección del agua

Primeros métodos de purificación tradicional

Antes de la era científica moderna, las civilizaciones implementaron diversos métodos empíricos para potabilizar el agua, muchos de los cuales buscaban mejorar su aspecto y palatabilidad, con efectos colaterales positivos en la higiene. Uno de los métodos más antiguos y universales es la ebullición: hervir el agua para luego dejarla enfriar ha sido practicado por siglos, y es efectivo eliminando patógenos por el calor. Textos de la antigua India y obras de médicos griegos como Hipócrates (460–370 a.C.) ya recomendaban hervir y colar el agua antes de beberla. Los egipcios, hacia 1500 a.C., también calentaban el agua al fuego o al sol, e incluso introducían hierro candente en ella para purificarla. Otra técnica temprana fue la filtración rudimentaria: pasar el agua a través de arena, grava, lana o carbón vegetal para retener impurezas. Se sabe que en el antiguo Egipto se filtraba el agua tras hervirla, y que en diversas culturas se usaba carbón (carbón activado natural) para mejorar el sabor y posiblemente adsorber contaminantes. Asimismo, almacenar agua en recipientes de metal (cobre o plata) era común; estos metales, se descubrió mucho después, tienen propiedades bactericidas leves. En resumen, hervir, filtrar y exponer el agua al sol fueron los pilares de la purificación tradicional, utilizados intuitivamente durante milenios. Aunque su eficacia contra bacterias o virus no se comprendía en la época, estos métodos proporcionaban una cierta protección frente a enfermedades y se transmitieron como saber empírico.

Primeras plantas de filtración y avances decimonónicos

El tratamiento del agua dio un salto cualitativo con la llegada de la Ilustración y la Revolución Industrial. A medida que crecían las ciudades en los siglos XVIII y XIX, la demanda de agua segura aumentó. La filtración lenta a través de arena se consolidó como la primera tecnología a gran escala para mejorar el agua. En 1804, se construyó en Paisley (Escocia) la primera planta pública de tratamiento de agua de la que se tiene registro: el inventor John Gibb instaló un filtro de arena para abastecer a su industria textil y vendió el excedente de agua filtrada al público. Este éxito inspiró a ingenieros como James Simpson, quien en 1829 diseñó para la compañía Chelsea Waterworks de Londres la primera planta municipal de agua tratada que abastecía a una ciudad entera. El sistema de Simpson consistía en estanques de sedimentación seguidos de grandes lechos de arena por los que se hacía percolar el agua del río Támesis, obteniendo agua clara y significativamente más segura. Tras la Metropolis Water Act de 1852 en Londres –que exigió por ley que toda el agua suministrada a la capital fuera “efectivamente filtrada”– la filtración se adoptó ampliamente en el Reino Unido y luego en Europa continental. Para fines del siglo XIX, muchas ciudades de Europa y Estados Unidos ya contaban con plantas de filtración lenta, reduciendo notablemente la carga de turbiedad y microbios en el agua.

No obstante, la filtración por sí sola no eliminaba todos los patógenos. Esto quedó evidenciado con epidemias persistentes de cólera y tifoidea en ciudades con agua filtrada pero sin desinfectar. Un caso paradigmático fue la epidemia de fiebre tifoidea en 1905 en Lincoln (Inglaterra): allí, un filtro de arena mal mantenido permitió el paso de bacterias y causó un brote grave. Estos eventos subrayaron la necesidad de una barrera adicional –la desinfección química– para garantizar la potabilidad. Ya desde mediados del siglo XIX se conocían algunos agentes químicos con capacidad desinfectante (por ejemplo, el cloro gaseoso había sido estudiado por su poder antiséptico). Sin embargo, hacer viable la desinfección de grandes volúmenes de agua requirió ensayos y desarrollos a fines del siglo XIX.

La introducción de la desinfección química: cloración, ozonización y más

La cloración del agua fue la primera gran técnica de desinfección adoptada globalmente, inaugurando la era de la potabilización moderna. El cloro como elemento químico fue descubierto en 1774 por Carl Wilhelm Scheele, y pronto se reconocieron sus propiedades desinfectantes en laboratorio. Durante la segunda mitad del siglo XIX, varios investigadores exploraron su aplicación al agua. Ya mencionamos que John Snow en 1854 utilizó compuestos de cloro (probablemente cloruro cálcico o “cal clorada”) para intentar purificar el agua de la bomba de Broad Street. Posteriormente, en 1879, William Soper empleó cal clorada para desinfectar aguas residuales de pacientes con fiebre tifoidea, evitando contagios. Un avance científico lo dio Moritz Traube, quien en 1894 propuso formalmente añadir hipoclorito de calcio al agua para hacerla “libre de gérmenes”. Sus experimentos demostraron la eficacia del cloro para eliminar bacterias en agua a pequeña escala. Esto llevó a las primeras implementaciones experimentales: en Hamburgo, Alemania, se probó la cloración del agua en 1893, y en 1897 la ciudad de Maidstone, Inglaterra, se convirtió en la primera del mundo en tratar todo su suministro de agua con cloro (como medida de emergencia durante una epidemia). Los resultados fueron prometedores, reduciendo drásticamente la incidencia de enfermedades.

El paso decisivo hacia la desinfección continua y preventiva ocurrió a inicios del siglo XX. En 1902 se instaló en Middelkerke (Bélgica) la primera planta permanente de cloración de agua a escala municipal. En este sistema pionero se dosificaba hipoclorito de calcio junto con cloruro férrico al agua antes de filtrarla, logrando simultáneamente coagulación de impurezas y desinfección. Poco después, el Reino Unido adoptó la cloración continua en varios acueductos urbanos; por ejemplo, tras el brote de Lincoln de 1905, se mantuvo la cloración preventiva de la fuente hasta 1911, con gran éxito en eliminar la tifoidea. Estados Unidos siguió de cerca estos desarrollos: en 1908, el Dr. John L. Leal implementó la primera cloración continua del agua en Norteamérica, tratando el suministro de Jersey City (Nueva Jersey) con una dosificación controlada de hipoclorito. La planta, diseñada por George W. Fuller, añadía soluciones diluidas de cloruro de cal hasta lograr una concentración residual de cloro de apenas 0,2-0,3 partes por millón, suficiente para inactivar bacterias. Los resultados inmediatos fueron contundentes: las muertes por fiebre tifoidea y otras enfermedades transmitidas por el agua cayeron drásticamente. Tras superar desafíos legales y escepticismo inicial (hubo juicios que cuestionaron la seguridad del cloro en el agua), el éxito de Jersey City propició una rápida difusión de la cloración. Para 1914, más de 21 millones de personas en EE. UU. recibían agua clorada y en 1918 ya eran 33 millones de habitantes en más de un millar de ciudades norteamericanas los beneficiados. La cloración se había establecido así como el método estándar de desinfección del agua en gran parte del mundo industrializado.

Paralelamente al cloro, se desarrollaron métodos alternativos de desinfección. Uno de los más importantes fue la ozonización. El ozono (O₃) es un potente agente oxidante; su capacidad para inactivar microorganismos se investigó a fines del siglo XIX. El gas ozono había sido descubierto en 1840 por el químico germano-suizo Christian F. Schönbein, quien le dio nombre al detectar su fuerte olor característico. A partir de ese hallazgo, se experimentó con ozono generado eléctricamente para tratar agua. El primer uso técnico documentado ocurrió en 1893 en Oudshoorn (Países Bajos), en una planta piloto estudiada por científicos franceses. Estos estudios culminaron en la instalación, en 1906, de la primera planta municipal de ozonización en Niza (Francia), diseñada por el ingeniero Marius Paul Otto. Desde 1906, el agua de la ciudad de Niza se esterilizaba con ozono de forma continua, lo que otorgó a esta localidad el título de “cuna de la ozonización de agua potable”. La ozonización probó ser efectiva para destruir bacterias y mejorar el sabor del agua (pues el ozono, a diferencia del cloro, no deja sabor químico residual). Durante las primeras décadas del siglo XX, varias ciudades europeas –especialmente en Francia, Alemania y los Países Bajos– adoptaron el ozono como desinfectante preferido en sus acueductos, valorando su poder oxidante y la ausencia de subproductos halogenados en el agua tratada.

Otro avance significativo en la evolución de técnicas fue la introducción de la desinfección por rayos ultravioleta (UV). Ya en 1877 se descubrió científicamente que la luz solar directa podía inactivar bacterias (Downes y Blunt demostraron la acción germicida de la radiación solar). Este principio se aplicó tecnológicamente a inicios del siglo XX con las recién inventadas lámparas de vapor de mercurio. En 1910, la ciudad de Marsella (Francia) inauguró la primera planta de desinfección de agua potable por luz ultravioleta. Aunque este sistema UV pionero operó exitosamente en inactivar microbios sin añadir ninguna sustancia química, la técnica no se difundió ampliamente en ese momento debido a la rápida hegemonía de la cloración (más sencilla y con efecto residual) y a limitaciones técnicas de las lámparas UV de la época. No sería hasta finales del siglo XX cuando la radiación UV resurgiría como método popular para desinfectar agua, especialmente en contextos donde se desea evitar los subproductos químicos.

En resumen, hacia la primera mitad del siglo XX la potabilización del agua contaba ya con un arsenal de técnicas comprobadas: la filtración (lenta y luego rápida con apoyo de coagulantes) para clarificar el agua, y la desinfección química con cloro o ozono para eliminar patógenos. La combinación de filtración seguida de desinfección se convirtió en el estándar de oro para asegurar agua segura. Gracias a ello, enfermedades históricamente devastadoras como el cólera, la disentería o la fiebre tifoidea disminuyeron drásticamente en las poblaciones que contaban con sistemas de agua tratada. La potabilización del agua fue reconocida pronto como una de las mayores contribuciones a la mejora de la salud pública mundial en el siglo XX.

Fechas clave y lugares pioneros en la potabilización del agua

A continuación se sintetizan algunos hitos históricos clave y lugares pioneros en el desarrollo de la potabilización del agua a nivel global:

-

1804 (Paisley, Escocia): Primera planta municipal de tratamiento de agua documentada, construida por John Gibb, utilizando filtración lenta con arena.

-

1829 (Londres, Inglaterra): James Simpson instala la primera planta de filtración para abastecimiento público (Chelsea Waterworks), suministrando agua filtrada a todos los residentes.

-

1854 (Londres, Inglaterra): John Snow vincula el cólera al agua contaminada durante el brote del Soho; clausura de la bomba de Broad Street y primera desinfección de emergencia con cloro en un suministro de agua.

-

1855 (Londres, Inglaterra): Entra en vigor la Metropolis Water Act, primera ley que exige estándares de calidad (filtración) para el agua potable urbana.

-

1883–1884: Robert Koch aisla el Vibrio cholerae, confirmando científicamente que la bacteria del cólera se transmite por el agua. (En 1854, Filippo Pacini en Italia ya había observado el bacilo, pero su descubrimiento pasó inadvertido).

-

1897 (Maidstone, Inglaterra): Primera ciudad con todo su suministro de agua clorado (durante una epidemia de fiebre tifoidea); marca el inicio del uso del cloro a escala municipal.

-

1902 (Middelkerke, Bélgica): Primera planta permanente de cloración de agua potable en el mundo, dosificando hipoclorito de calcio y coagulante férrico antes de la filtración.

-

1905 (Lincoln, Inglaterra): Primer uso continuado de cloración preventiva tras una epidemia de tifus; la cloración del agua de Lincoln se mantuvo hasta 1911, sirviendo de modelo para otros sistemas.

-

1906 (Niza, Francia): Primera planta de ozonización a gran escala para desinfectar agua potable; inicio del uso continuo de ozono en un acueducto municipal.

-

1908 (Jersey City, EE. UU.): Primer sistema municipal de cloración permanente en América, aplicado al embalse de Boonton (New Jersey); diseñado por John L. Leal y George W. Fuller.

-

1910 (Marsella, Francia): Primera instalación de desinfección por rayos UV en una red de agua potable en el mundo.

-

1914: Se establecen en EE. UU. los primeros estándares bacteriológicos formales para agua potable (conteo de bacterias coliformes), anticipando regulaciones modernas.

-

1918: Más de mil ciudades en Norteamérica utilizan cloro en sus sistemas de agua, beneficiando a unos 33 millones de habitantes. La potabilización química se extiende globalmente.

Estos hitos reflejan cómo, en el transcurso de apenas unas décadas, la humanidad pasó de confiar en métodos artesanales a implementar soluciones científico-técnicas para asegurar agua libre de patógenos.

Cloro y ozono en la desinfección del agua: descubrimiento e implementación

Dos desinfectantes químicos sobresalen en la historia temprana de la potabilización del agua por su eficacia y adopción: el cloro y el ozono. A continuación se examina el papel de cada uno, incluyendo cómo fueron descubiertos y cómo se implementaron en los sistemas de agua potable.

El cloro como desinfectante: un logro de la salud pública

El cloro (Cl₂) es un gas amarillo-verdoso descubierto en 1774 por Carl W. Scheele. A finales del siglo XVIII y XIX, sus compuestos (como el hipoclorito de calcio, conocido como “cloruro de cal” o lejía en polvo) se usaban como blanqueadores y antisépticos. Su potente acción germicida llevó a varios científicos a probarlo contra los patógenos del agua. Como se mencionó, John Snow fue pionero al emplear cloro en 1854 para desinfectar un pozo durante una epidemia de cólera. Décadas después, ensayos sistemáticos (Traube 1894, investigadores en 1895) confirmaron que añadir dosis bajas de cloro al agua podía eliminar las bacterias causantes de enfermedades. Esto abrió el camino a las primeras aplicaciones prácticas en el tratamiento de aguas: en 1897 Maidstone demostró en la práctica la eficacia del cloro para detener un brote de tifus. La consolidación llegó en los primeros años del siglo XX con las experiencias exitosas de cloración continua en Europa (Bélgica 1902, Inglaterra 1905) y Estados Unidos (Jersey City 1908) que ya hemos descrito. A partir de entonces, la adopción mundial fue exponencial.

El mecanismo por el cual el cloro desinfecta es la oxidación de componentes celulares de los microorganismos. Disuelto en agua forma ácido hipocloroso, capaz de penetrar las células bacterianas e inactivar enzimas vitales, provocando la muerte del patógeno. Una gran ventaja del cloro es que deja un residuo libre en el agua (cloro residual) que permanece activo durante la distribución, protegiendo frente a recontaminación en las tuberías hasta el punto de consumo. Además, el cloro era barato y relativamente fácil de dosificar con la tecnología de la época (al inicio se usó hipoclorito en solución; pronto se desarrolló también la dosificación de cloro gas licuado, introducida por el militar británico Vincent B. Nesfield en 1903, lo que permitió sistemas más compactos). Gracias a estas cualidades, la cloración se convirtió en el método dominante de desinfección durante el siglo XX. Los resultados en salud pública fueron espectaculares: en EE. UU., por ejemplo, la introducción de agua clorada se asoció con una caída brusca de las tasas de mortalidad por enfermedades entéricas y un aumento notable de la esperanza de vida.

Organismos internacionales han reconocido la importancia del cloro en la historia sanitaria. Los Centros para el Control y Prevención de Enfermedades (CDC) de EE. UU. declararon la cloración del agua como uno de los mayores logros de la salud pública del siglo XX. Sin embargo, con el tiempo también se identificaron efectos no deseados. El cloro puede reaccionar con materia orgánica natural presente en el agua, formando compuestos secundarios conocidos como subproductos de desinfección (SPD). Entre ellos destacan los trihalometanos (THM), como el cloroformo, que en estudios prolongados mostraron potencial carcinogénico. A partir de la década de 1970, esta preocupación llevó a ajustes normativos para limitar la concentración de THM en el agua potable. No obstante, entidades como la Organización Mundial de la Salud (OMS) enfatizan que los riesgos de estos subproductos son extremadamente pequeños en comparación con el peligro de una desinfección inadecuada; es decir, la ausencia de desinfección representa un riesgo mucho mayor para la salud pública que la presencia controlada de trazas de subproductos. En la actualidad, el cloro (y formas relacionadas como la cloramina) sigue siendo el desinfectante más utilizado en el mundo debido a su balance óptimo entre eficacia, costo y protección residual.

El ozono como desinfectante: pionero alternativo

El ozono (O₃) es una forma alotrópica del oxígeno con un poder oxidante superior al del cloro. Fue identificado en 1840 por Christian Schönbein, quien notó su fuerte olor tras descargas eléctricas. Aunque inicialmente se estudió en contextos de laboratorio, pronto se sugirió su uso para purificar aire y agua. El ozono tiene la capacidad de destruir bacterias, virus y otros patógenos oxidando sus componentes celulares (paredes, membranas y ácidos nucleicos). A diferencia del cloro, el ozono se descompone rápidamente y no deja un residual prolongado en el agua, lo cual es una ventaja en términos de gusto y compuestos secundarios, pero significa que no protege contra recontaminación posterior.

La implementación del ozono en agua potable fue liderada por ingenieros europeos. Tras las primeras pruebas en los años 1890, la planta de Niza (1906) marcó el inicio de su aplicación a gran escala. Desde entonces, el ozono se adoptó en varias ciudades de Francia, Bélgica, Países Bajos y Suiza en la primera mitad del siglo XX, a menudo en combinación con filtración. Sus principales ventajas eran la rápida inactivación de microorganismos con dosis y tiempos de contacto menores que el cloro, y la ausencia de subproductos halogenados (no forma trihalometanos, a menos que el agua contenga bromuros). Esto hacía la ozonización especialmente atractiva para mejorar sabor y olor del agua, y evitar riesgos químicos. Por ello, plantas “altamente tecnificadas” o con requisitos organolépticos exigentes empezaron a preferir ozono en lugar de cloro.

No obstante, el ozono presentaba también desafíos. Su molécula es muy inestable, por lo que debe generarse in situ (en el propio lugar de tratamiento) mediante aparatos eléctricos, resultando en sistemas más complejos y costosos de operar que la simple dosificación de cloro. Además, como se mencionó, el ozono no proporciona un efecto residual: el agua ozonizada podía volver a contaminarse si las tuberías o depósitos no estaban bien protegidos, razón por la cual en algunos sistemas se combina ozonización en planta con un leve aporte de cloro o cloramina antes de la distribución. Pese a estas limitaciones, el ozono se consolidó como alternativa clave y hoy sigue utilizándose, especialmente en Europa, para grandes acueductos. Un ejemplo clásico es la planta de ozonización de París (instalada en 1911 y modernizada posteriormente), que ha garantizado agua de excelente calidad para la capital francesa durante más de un siglo. En décadas recientes, con la preocupación por subproductos de cloración, ha habido un resurgimiento en el interés por el ozono e incluso por tecnologías combinadas (ozono seguido de carbón activado, etc.) que aprovechan su capacidad de oxidar contaminantes químicos además de desinfectar.

En síntesis, tanto el cloro como el ozono jugaron papeles protagónicos en los comienzos de la potabilización del agua a nivel global. El cloro brindó una solución económica, robusta y residual que salvó incontables vidas al prevenir epidemias de agua contaminada. El ozono, por su parte, ofreció una vía alterna más poderosa y “limpia” en términos químicos, aunque sin residual, convirtiéndose en el desinfectante preferido en ciertos países y situaciones. La existencia de ambos amplió el repertorio de la ingeniería sanitaria para adaptar la desinfección a distintas necesidades.

Conclusiones

La potabilización del agua —entendida como el conjunto de procesos para hacer el agua segura al consumo humano— tuvo sus inicios en prácticas ancestrales, pero se desarrolló científicamente a partir del siglo XIX cuando quedó evidenciada la relación entre agua y enfermedad. El contexto histórico de crecientes epidemias urbanas y avances científicos en microbiología impulsó la transición desde métodos empíricos (hervir, filtrar, decantar) hacia técnicas de desinfección eficaces. Los principales descubrimientos, como los de John Snow al rastrear el cólera hasta el agua contaminada, o los de Koch al aislar patógenos, cimentaron la necesidad de tratar el agua con rigor. En pocas décadas se sucedieron hitos fundamentales: la filtración lenta, la cloración, la ozonización y la radiación UV, entre otros, sentando las bases de los sistemas modernos de agua potable. Los lugares pioneros –desde Paisley y Londres hasta Middelkerke, Niza o Jersey City– fueron laboratorios a cielo abierto donde se probaron y perfeccionaron estas soluciones, que luego se difundieron globalmente.

A comienzos del siglo XX, la desinfección del agua emergió como una piedra angular de la salud pública, reduciendo dramáticamente la incidencia de enfermedades transmitidas por el agua. En especial, la cloración se consagró por su impacto y practicidad, al punto de ser aclamada como un logro sanitario sin precedentes. El ozono complementó este panorama ofreciendo ventajas en situaciones específicas, ilustrando que no existía una única vía para lograr agua segura. Con el tiempo, estas tecnologías se perfeccionaron y se incorporaron nuevos métodos (como la cloramina, el dióxido de cloro, las membranas filtrantes, etc.), pero siempre sobre el fundamento establecido por estos comienzos históricos.

En conclusión, los inicios de la potabilización del agua a nivel global representan una historia de innovación científica y esfuerzo ingenieril motivados por la urgencia de proteger la vida humana. Las lecciones aprendidas en ese periodo –la importancia de la evidencia epidemiológica, la necesidad de estándares de calidad, y la búsqueda de equilibrios entre eficacia y seguridad química– siguen guiando la gestión del agua en la actualidad. Gracias a aquellos primeros pasos, hoy gran parte de la humanidad puede abrir un grifo y beber agua confiando en que está libre de microorganismos nocivos, un hecho cotidiano que descansa sobre siglos de conocimiento y sobre hitos históricos que revolucionaron la salud pública.